“사진 보고 사람처럼 척척 대답”

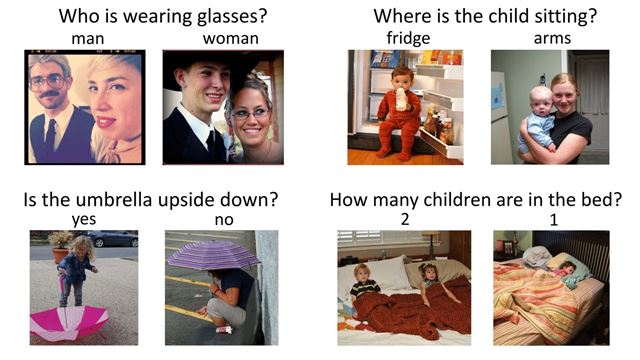

아이들이 침대에 누운 사진을 보여 주고, “아이 몇 명이 침대에 있나”라고 인공지능(AI)에 물으면 정확한 답을 내놓을 수 있을까. 시각 정보와 인간의 언어를 AI가 얼마나 분석ㆍ처리할 수 있는지 겨루는 국제 AI 대회에서 서울대 연구팀이 준우승을 차지했다.

서울대 공대는 컴퓨터공학부 장병탁 교수 연구팀(팀원 김진화 박사과정ㆍ전재현 석사과정)이 18일(현지시간) 미국 유타주 솔트레이크시티에서 열린 ‘2018 컴퓨터비전패턴인식학회(CVPR)’ 워크숍인 ‘AI 시각 질의응답 대회(VQA Challenge)’에서 공동 2위에 올랐다고 25일 밝혔다. 전세계에서 참가한 40개 팀 중 장 교수 연구팀은 단일모델 부문에서 가장 우수한 성능을 보였으나, 앙상블모델 성능에서 근소한 차이로 뒤쳐져 총점 71.69점을 받았다. 우승은 총점 72.41점을 받은 페이스북 AI 연구팀에게 돌아갔다. 단일모델 부문은 AI 모델 1개의 성능을 평가하고, 앙상블모델 부문은 모델 여러 개를 합쳐 성능을 평가한다.

2016년부터 매년 열리는 AI 시각 질의응답 대회는 이미지를 보여주고 질문을 던지면 AI가 답하는 방식으로 진행된다. AI는 이미지 12만 개, 이미지에 대한 질문 65만 개, 답변 650만 개를 학습한 뒤 질문에 대한 알맞은 답을 내린다. 예컨대 안경 쓴 남자와 쓰지 않은 여자가 있는 사진을 보여 주고 “누가 안경을 썼나”고 물으면 ‘남자’ 혹은 ‘여자’ 답을 하는 식이다. 연구팀은 “시각 정보와 인간의 언어를 이해하는 AI 개발은 무인카메라가 스스로 주어진 정보를 토대로 목표물을 찾는 것을 가능하게 할 것”이라고 설명했다.

손영하 기자 frozen@hankookilbo.com

기사 URL이 복사되었습니다.

댓글0