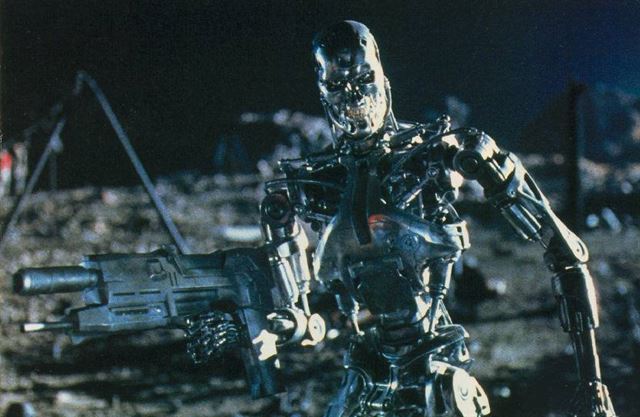

"스스로 타깃 설정해 공격하는 무기, 군비경쟁과 인류 종말 초래할 것"

우주물리학자 스티븐 호킹 박사와 테슬라 모터스의 경영자 일론 머스크, 애플의 공동 창업자 스티브 워즈니악 등 1,000명이 넘는 인공지능(AI)ㆍ로봇 전문가들이 AI 기술의 군사적 이용 금지를 호소하는 공개 서한을 발표했다. 이들은 AI가 전쟁에 이용될 경우 인류에 재앙이 일어날 수 있다고 경고했다.

이들은 27일 아르헨티나 부에노스아이레스에서 열린 국제AI학회를 통해 공개한 서한에서 “AI 기술이 수년 내에 군사 로봇을 상용화시킬 만큼의 수준에 도달했기 때문에 위험성이 크다”고 지적했다. 인간이 직접 조종하지 않아도 스스로 타깃을 설정해 공격하는 무기가 개발된다면 전쟁의 문턱을 낮춰 훨씬 큰 피해를 초래할 것이며 원자폭탄이 개발될 때처럼 군비경쟁이 심화할 것이라고 이들은 우려했다. 연구자들은 “자동화 군사로봇은 화약과 핵무기에 이어 3차 전쟁 혁명이라고 할 수 있다”고 지적했다.

토비 월시 호주 뉴사우스웨일스대 교수는 이번 서한과 관련해 “우리의 미래가 걸린 결정을 오늘 내려야 한다”며 “시력 마비 레이저 무기 사용을 금지했던 것처럼 자동화 군사로봇 사용을 금지할 수 있도록 우리는 여러 인도주의 단체들을 지지해야 한다”고 말했다. 호킹과 머스크도 “AI가 우리의 가장 큰 존재론적 위협”이라며 “완전한 AI는 인류의 종말을 초래할 수도 있다”고 경고했다.

AIㆍ로봇 전문가들이 우려하는 건 인간이 조종하는 크루즈 미사일이나 무인 항공기가 아니라 미리 지정된 기준에 따라 스스로 타깃을 찾아내 공격하는 자동화 무기다. 서한에서 연구자들은 “AI 무기를 개발하는 나라가 나온다면 군비경쟁이 지구 전체로 퍼져나가는 걸 사실상 막기 힘들 것”이라며 “자동화 무기는 미래의 AK소총이 될 것”이라고 강조했다.

살상용 군사로봇 개발에 대한 반발은 오래 전부터 있었다. 미국 국방부는 2000년대 초부터 인간을 대신해 전투에 투입할 로봇을 개발했고 전장에서 무인 항공기를 운영하며 적잖은 사상자를 냈다. 이에 2013년 AIㆍ로봇 관련 학자들과 국제인권단체, 노벨평화상 수상자들이 모여 살상용 로봇을 반대하는 캠페인을 열었고, 같은 해 유엔 특별보고관 크리스토프 헤인즈는 살인 로봇 개발을 금지해야 한다는 보고서를 냈다. 영국의 AI 관련 기업 ‘딥마인드’(DeepMind)는 지난해 구글에 인수되면서 자사 기술을 군사적 목적으로 사용할 수 없다는 조건을 내 걸기도 했다.

지난해 11월 유엔특별회의에서는 급속히 발전하는 살상용 로봇 기술의 잠재적 위험을 경고하며 인간이 이들 로봇을 통제할 수 있도록 국제법에 명시해야 한다는 주장도 나왔다. 당시 미하엘 뮬러 유엔 유럽본부 사무총장 대행은 이 회의 개막 기조연설에서 무기에 대한 인간 통제의 원칙을 강조하며 1990년대 중반 시력을 마비시키는 레이저 무기가 실전에 배치되기 전 미리 국제법으로 금지한 선례를 뒤따를 만하다고 지적했다.

이 회의에서는 노벨평화상 수상자 조디 윌리엄스와 인권단체 휴먼라이츠워치(HRW) 등이 주도하는 킬러로봇 반대단체 ‘스톱 더 킬러로봇’이 “인간이 킬러로봇의 개발과 배치, 운용 등을 제어할 최소한의 수단이 필요하다”며 민간인 살상을 금지한 제네바협약 같은 국제 규제 마련도 촉구했다.

고경석기자 kave@hankookilbo.com

기사 URL이 복사되었습니다.

댓글0