“네이버 책임 강화를” 목소리에

‘AI 뉴스 배열’ 올해 도입 선언

가짜뉴스ㆍ정보편식 부작용 우려

전문가 “공공성 강화 필요” 지적

네이버가 불리한 기사를 노출하지 말아 달라는 외부 청탁을 받고 뉴스 배열을 조작했다는 의혹이 사실로 드러나면서, 사실상 언론의 역할을 하는 네이버의 책임을 강화해야 한다는 목소리가 높아지고 있다. 최근 네이버가 그 대책으로 사람 대신 인공지능(AI)에 배열을 맡기는 등 뉴스 서비스를 개편했지만 여론 조작을 막기에는 부족하다는 지적이 나온다.

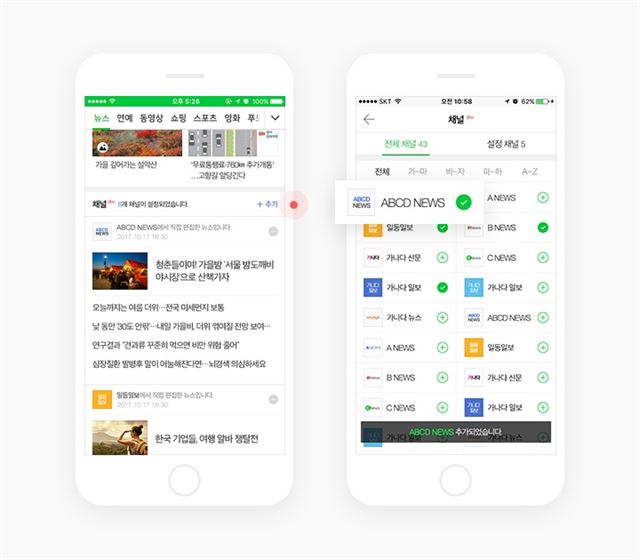

23일 정보기술(IT) 업계에 따르면 네이버는 지난 17일 사람 편집자의 개입을 최소화하는 방향으로 모바일 뉴스 서비스를 전면 개편했다. 지금까지 네이버 소속 뉴스 편집 인력이 중요도, 시의성 등을 판단해 기사를 선별해 노출했지만, 개편에 따라 언론사가 직접 편집하는 영역이 새로 생겼다. 여기에 인공지능이 이용자 개개인의 취향을 분석해 뉴스를 추천하는 시스템 ‘에어스’도 올해 안에 도입될 예정이다. 이렇게 되면 네이버 뉴스 화면에서 사람 편집자에 의해 기사가 배열되는 영역이 20% 이하로 축소된다는 것이 네이버 측 설명이다.

페이스북, 구글 등 글로벌 플랫폼이 이미 수년 전부터 뉴스 편집을 인공지능에 맡겨 온 것을 감안하면 네이버의 이번 개편은 다소 늦은 감이 있다. 그간 네이버는 기사 제목을 읽는 즉시 가치를 판단할 수 있는 사람보다 인공지능의 속보 대응 능력이 떨어진다는 등 이유로 사람 편집 방침을 고수했지만, 여론을 조작한다는 비판이 끊이지 않자 결국 백기를 든 것으로 업계에서는 해석하고 있다.

하지만 전문가들은 인공지능에 편집을 맡기는 방식도 임시방편에 불과하다고 말한다. 인공지능 편집이 가져올 수 있는 가장 큰 문제는 정보의 편식이다. 이용자는 인공지능의 추천을 받아 원하는 정보를 얻을 수 있어 편하지만, 반대로 반드시 알아야 할 현실에 대한 정보를 사전에 차단당할 위험도 있다.

인공지능이 사람보다 가짜뉴스를 가려내는 데 취약하다는 지적도 나온다. 지난해 미국 대선 때 가짜 뉴스 양산지로 지목된 페이스북의 경우 최근 미국 라스베이거스 총기 난사 사건 발생 이후 거짓 정보가 횡행하자 뉴스 작성자의 위키피디아 검색 결과를 함께 노출하는 방식으로 아예 알고리즘을 변경했다. 해당 뉴스 작성자가 신뢰할 만한 사람인지를 이용자가 스스로 판단할 수 있도록 하기 위해서다.

이를 고려하면 인공지능 도입은 사회적 책임을 다하려는 노력과는 거리가 멀다는 비판이 나온다. 최진봉 성공회대 교수는 “인공지능을 만드는 것도 결국 사람”이라며 “인공지능 알고리즘을 외부에 모두 공개하거나, 아예 전문가들이 인공지능 개발에 참여하는 방식으로 투명성을 강화해야 뉴스 플랫폼으로서 신뢰받을 수 있을 것”이라고 말했다. 이용성 한서대 교수는 “네이버가 국내 뉴스 유통에 막대한 영향력을 행사하는 있는 만큼, 뉴스 편집 알고리즘과 배열 이력을 감시하는 이용자위원회를 법제화해 공공성을 강화할 필요가 있다”고 조언했다.

이서희 기자 shlee@hankookilbo.com

기사 URL이 복사되었습니다.

댓글0